- Главная

- >

- Роботы

- >

- Медицинские роботы

- >

- Робот аптекарь в домах престарелых

Робот аптекарь в домах престарелых

Почему мы нервничаем, когда думаем о роботах, работающих среди нас, а не привязанных к заводскому цеху? Мы уже зависим от сотен, если не тысяч автоматизированных систем и процессов. Мы летаем на самолетах, которые летают сами. Наша электрическая сеть может перенаправить себя, чтобы избежать перебоев в подаче электроэнергии. Мы ожидаем, что эти системы будут надежными и безопасными, и делать то, что они были запрограммированы, и ничего больше.

Возможно, в этом и смысл. Машины и системы, о которых мы сообщаем в этом вопросе, должны быть в состоянии принимать решения, основанные не только на гигантских наборах данных, но и на поведении людей и социальных правилах, обычаях, законах и ценностях, которые мы используем для навигации по нашему миру. Они должны быть в состоянии понять “правильную” вещь, чтобы сделать в реальном времени, как любой из нас мог бы, чтобы свернуть вокруг пешеходного перехода, выполнить спасительный хирургический маневр или отличить дружественных граждан от вражеских солдат в зоне боевых действий, все без помощи человеческой руки.

Чтобы построить роботов, которые внушают доверие, роботисты работают с психологами, социологами, лингвистами, антропологами и другими учеными, чтобы понять гораздо больше о том, что делает нас надежными и надежными во всех различных ролях, которые мы играем.

Это не легко. Как отмечает Мег Лета Джонс, ученый из юриспруденции и технологий в Университете Джорджтауна, вы должны быть очень точными относительно того, что вы хотите доверять роботу. «На что он способен? Как система выражает свою способность к человеческому пользователю, и является ли она точной? Вы должны быть в состоянии ответить на эти вопросы, чтобы определить ожидания, чтобы создать надежное доверие. Мы еще не знаем, как это сделать ».

Еще одна сложная часть дизайна роботов учитывает разницу между тем, что люди говорят, что им нужна машина, и что они действительно хотят сделать. Так, например, если вы спросите людей, хотят ли они, чтобы роботы были на 100 процентов правдивыми, каждый, вероятно, начнет говорить «да». Но из психологических исследований мы знаем, что если робот на 100 процентов правдивый, люди начинают негодовать. Поэтому дизайнерам необходимо рассмотреть вопрос о предоставлении ему правдивости - в отличие от наших собственных. Роботам также нужно будет показать некоторые манеры. Нам будет гораздо больше доверять машинам, которые смогут объяснить свои намерения и спросить наше разрешение, прежде чем приступить к их работе.

Общественный резонанс в отношении «убийственных роботов» немного преждевременен. В конце концов, лучшие и самые замечательные автономные роботы, которые мы видели до сих пор, - это те, которые играют люди - Терминатор Арнольда Шварценеггера, Саманта Скарлетт Йоханссон в ней и мой новый личный фаворит, Билл Ирвин, как ТАРС в Interstellar.

Но фуллер робота-убийцы также блистателен, потому что он помогает продвигать определенные проблемы в глазах общественности. Эти проблемы, возникающие в промышленности и научном сообществе, распространяются на всех роботов - восхитительных, которые могут петь наших детей, чтобы спать, и тех, кто не выглядит таким, как мы, который может занять наши рабочие места. Фурор представляет нам прекрасную возможность, чтобы все исправить, а не повторять ошибки, сделанные в отношении конфиденциальности и безопасности, ответственности и прав человека, в стремительном стремлении создать современный Интернет. Приписывать моральное агентство машинам, давать им «этику», кажется надуманным в обозримом будущем. В конце концов, это не разумные существа. Но мы, люди, безусловно, несли этическую ответственность за то, чтобы дать им алгоритмически богатые и тонкие «умы», с которыми можно было бы взаимодействовать с нами. Они могут быть только моральными и этическими, такими же сострадательными и справедливыми, как и мы.

Похожие статьи:

Современные инвалидные коляски

Современные инвалидные коляски

Стволовые клетки и ИИ лучше вместе

Стволовые клетки и ИИ лучше вместе

Робот-сиделка VGo

Робот-сиделка VGo

Робот онколог-диагност IBM Watson

Робот онколог-диагност IBM Watson

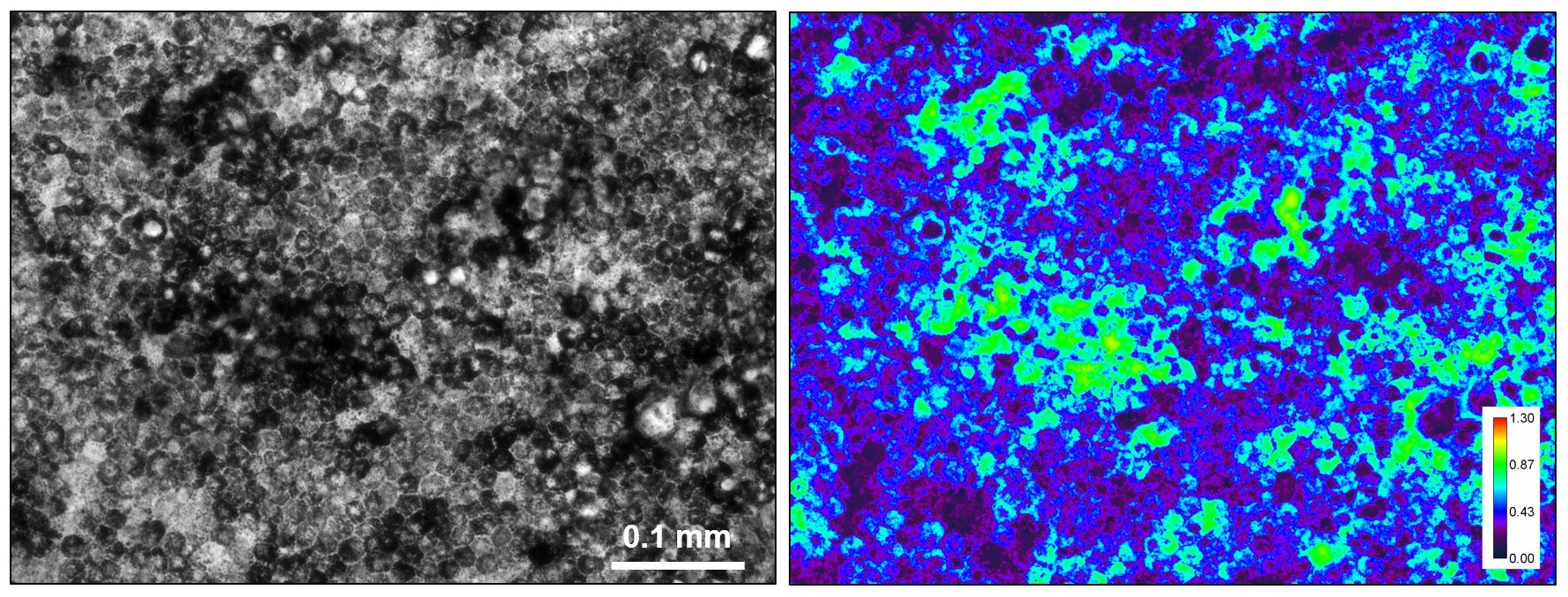

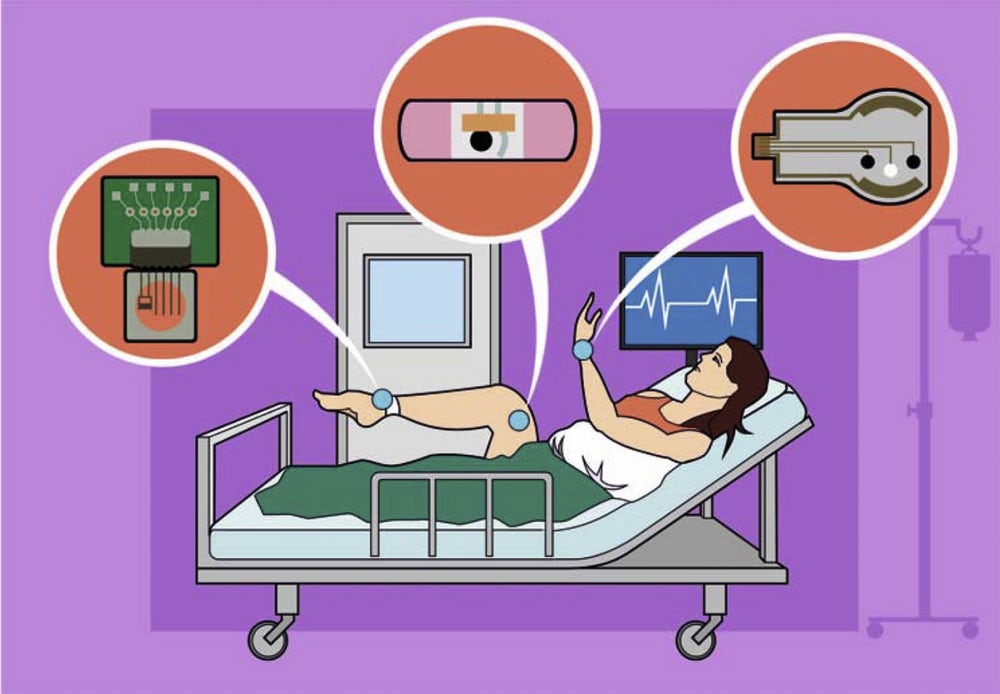

Многоцелевые электрохимические датчики - это будущее фитнеса и медицинских носимых изделий

Многоцелевые электрохимические датчики - это будущее фитнеса и медицинских носимых изделий

Анализирует рентген грудной клетки одобрен FDA - Critical Care Suite

Анализирует рентген грудной клетки одобрен FDA - Critical Care Suite